Introducciรณn a la Cumbre de Seguridad de la IA

Actualizado 31 octubre 2023

Introducciรณn a la Cumbre de Seguridad de la IA

1. Cumbre de seguridad de la IA: introducciรณn

Estamos en medio de una revoluciรณn tecnolรณgica que alterarรก fundamentalmente la forma en que vivimos, trabajamos y nos relacionamos unos con otros. La era de la Inteligencia Artificial (IA) ha comenzado y promete transformar aรบn mรกs casi todos los aspectos de nuestra economรญa y sociedad, trayendo consigo enormes oportunidades, pero tambiรฉn riesgos que podrรญan amenazar la estabilidad global y socavar nuestros valores.

Las oportunidades de transformaciรณn son amplias: avanzar en el descubrimiento de fรกrmacos, hacer que el transporte sea mรกs seguro y limpio, mejorar los servicios pรบblicos, acelerar y mejorar el diagnรณstico y tratamiento de enfermedades como el cรกncer y mucho mรกs. Sin embargo, para aprovechar estas oportunidades, debemos asumir los riesgos, no solo como paรญs sino como un esfuerzo global, razรณn por la cual estamos organizando la primera Cumbre Global sobre Seguridad de la IA.

La Cumbre de Seguridad de la IA se centrarรก en cรณmo gestionar mejor los riesgos de los avances mรกs recientes en IA (โIA de fronteraโ, ver mรกs abajo). Estos riesgos requieren una conversaciรณn internacional urgente dado el rรกpido ritmo al que se estรก desarrollando esta tecnologรญa. La naturaleza dinรกmica de la IA significa que puede ser difรญcil predecir sus riesgos. Diferentes variables (cรณmo estรก diseรฑada la IA, los usos que se le da, los datos con los que se alimenta) pueden interactuar de maneras que son casi imposibles de predecir. Los gobiernos, acadรฉmicos, empresas y grupos de la sociedad civil deben trabajar juntos para comprender estos riesgos y sus posibles soluciones.

En el camino hacia la Cumbre, existirรกn varias oportunidades para que las personas contribuyan a un debate inclusivo. La Cumbre en sรญ reunirรก a un pequeรฑo nรบmero de paรญses, sector acadรฉmico, representantes de la sociedad civil y empresas que ya han reflexionado en esta รกrea para iniciar una conversaciรณn global crรญtica. Este es el tema central de la primera Cumbre de Seguridad de la IA organizada por el Reino Unido en Bletchley Park y un diรกlogo que continuaremos a partir de este evento.

2. Alcance de la Cumbre de Seguridad de la IA: ยฟquรฉ es Frontier AI?

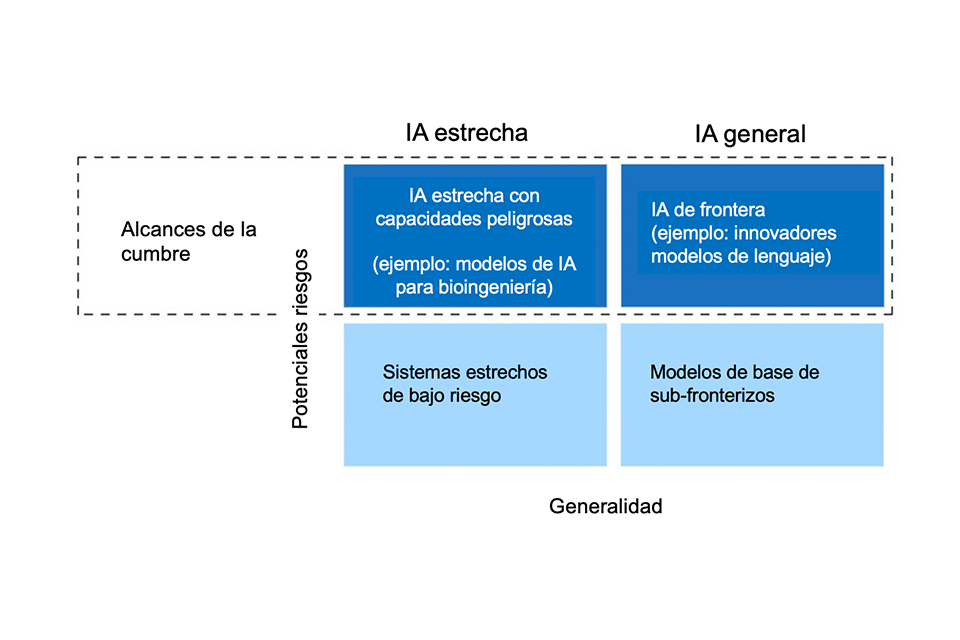

La Cumbre se centrarรก en ciertos tipos de sistemas de IA, en funciรณn de los riesgos que puedan plantear. Como se establece a continuaciรณn, estos riesgos podrรญan surgir de las capacidades mรกs potencialmente peligrosas de la IA, que entendemos que se encuentran tanto en la โfronteraโ de la IA de propรณsito general como, en algunos casos, de la IA especรญfica y limitada que puede contener capacidades potencialmente peligrosas.

Entendemos que la IA de frontera son modelos de IA de uso general, altamente capaces y que pueden realizar una amplia variedad de tareas e igualar o superar las capacidades presentes en los modelos mรกs avanzados de la actualidad. Estos se basan en una serie de definiciones existentes utilizadas por diversos actores corporativos y de la sociedad civil.

Ademรกs de discutir nuestra comprensiรณn de este tema con los asistentes a la Cumbre, el Reino Unido estรก avanzando en el trabajo para identificar especรญficamente dรณnde se encuentra actualmente la frontera del desarrollo de la IA y hacia dรณnde puede avanzar en el futuro.

Las tecnologรญas de IA estรกn evolucionando a una velocidad sin precedentes. Pronto, es posible que se lancen modelos mucho mรกs potentes que los disponibles actualmente. Las capacidades de estos modelos son muy difรญciles de predecir (a veces incluso para quienes los construyen) y, por defecto, podrรญan ponerse a disposiciรณn de una amplia gama de actores, incluidos aquellos que podrรญan desearnos hacernos daรฑo. Este ritmo de cambio significa que se necesitan medidas urgentes en materia de seguridad de la IA. Estamos en una encrucijada en la historia de la humanidad y girar en otra direcciรณn serรญa una enorme oportunidad perdida para la humanidad.

Si bien la Cumbre se centrarรก en la IA de vanguardia, tambiรฉn serรก importante considerarlos junto con los riesgos de esta tecnologรญa en ciertos casos de uso, es decir, a veces, como sistemas de IA limitados. Esto se debe a que no podemos predecir completamente el desarrollo de la tecnologรญa y no podemos saber con certeza cuรกn limitados o generales serรกn los sistemas de IA mรกs riesgosos del futuro, o en quรฉ medida se pueden crear riesgos mediante el uso de IA limitada como herramientas para la IA general.

Alcance de la Cumbre de Inteligencia Artificial

Actualmente, la seguridad de la IA no tiene una definiciรณn universalmente aceptada, y es mejor considerarla como la prevenciรณn y mitigaciรณn de los daรฑos causados por la IA. Estos daรฑos podrรญan ser deliberados o accidentales; dirigidos a individuos, grupos, organizaciones, naciones o globalmente; y de muchos tipos, incluidos, entre otros, daรฑos fรญsicos, psicolรณgicos o econรณmicos.

2.1 Enfoque y objetivos

Como se ilustra en el diagrama anterior, hay un pequeรฑo conjunto de daรฑos potenciales que es mรกs probable que se produzcan en la frontera o, en un pequeรฑo nรบmero de casos, a travรฉs de sistemas restringidos muy especรญficos. Hay dos categorรญas particulares de riesgo en las que nos centramos:

1. Riesgos por uso indebido, por ejemplo, cuando un mal actor recibe ayuda de nuevas capacidades de IA en ataques biolรณgicos o cibernรฉticos, desarrollo de tecnologรญas peligrosas o interferencia crรญtica en sistemas. Si no se controla, esto podrรญa causar daรฑos importantes, incluida la pรฉrdida de vidas.

2. Riesgos por pรฉrdida de control que podrรญan surgir de sistemas avanzados, que buscarรญamos estuvieran alineados con nuestros valores e intenciones.

La Cumbre, al analizar especรญficamente la seguridad de la IA en la frontera, se centrarรก particularmente en estas dos รกreas. Esto obedece a la necesidad urgente de una conversaciรณn internacional sobre cรณmo podemos trabajar juntos para enfrentar los nuevos desafรญos que plantean estos riesgos, combatir el uso indebido de modelos por parte de actores no estatales y promover las mejores prรกcticas. Este enfoque se basa en el trabajo que aborda otros riesgos y daรฑos de la IA, incluso en la OCDE, la Asociaciรณn Global sobre IA y el Consejo de Europa, y el Proceso de Hiroshima sobre IA.

Lo anterior no pretende minimizar los riesgos sociales mรกs amplios que dicha IA (tanto en la frontera como fuera de ella) puede tener, incluida la desinformaciรณn, el sesgo, la discriminaciรณn y el potencial de automatizaciรณn masiva. El Reino Unido considera que la mejor manera de abordar estos problemas es mediante los procesos internacionales existentes que estรกn en marcha, asรญ como los respectivos procesos internos de las naciones. Por ejemplo, en el Reino Unido estos riesgos se estรกn considerando a travรฉs del trabajo anunciado en el white paper sobre la regulaciรณn de la IA y a travรฉs de un trabajo mรกs amplio en todo el gobierno. Por lo tanto, es importante que el enfoque de la Cumbre sea complementario y no duplicativo de estos esfuerzos existentes, y que el Reino Unido y otras naciones continรบen trabajando a buen ritmo en todos estos foros para abordar toda la gama de riesgos.

Por lo tanto, acogemos con satisfacciรณn el trabajo realizado por nuestros socios internacionales para identificar medidas voluntarias apropiadas que puedan implementarse en ritmo y de forma provisional, mientras nuestra comprensiรณn de la tecnologรญa continรบa evolucionando.

La primera Cumbre de Seguridad de la IA tiene cinco objetivos:

-

una comprensiรณn compartida de los riesgos que plantea la IA de frontera y la necesidad de actuar

-

un proceso de avance para la colaboraciรณn internacional en materia de seguridad de la IA en la frontera, incluida la mejor manera de apoyar los marcos nacionales e internacionales

-

medidas apropiadas que las organizaciones individuales deberรญan tomar para aumentar la seguridad de la IA en la frontera

-

รกreas de posible colaboraciรณn en la investigaciรณn de la seguridad de la IA, incluida la evaluaciรณn de las capacidades del modelo y el desarrollo de nuevos estรกndares para respaldar la gobernanza

-

demostrar cรณmo garantizar el desarrollo seguro de la IA permitirรก que la IA se utilice para el bien a nivel mundial

3. Camino hacia la Cumbre โ Compromiso

La Cumbre es solo el comienzo de un proceso global para identificar, evaluar y, en รบltima instancia, mitigar los riesgos de la IA de vanguardia para que todas las personas podamos disfrutar de los beneficios pรบblicos que la IA puede aportar.

Michelle Donelan, Secretaria de Estado de Ciencia, Innovaciรณn y Tecnologรญa del gobierno britรกnico, anunciรณ el inicio del compromiso formal antes de la Cumbre a principios de septiembre con Jonathan Black y Matt Clifford, Representantes del Primer Ministro para la Cumbre de Seguridad de la IA, iniciando conversaciones con los paรญses y un nรบmero de organizaciones lรญderes en IA de vanguardia. La Secretaria de Estado tambiรฉn organizรณ una mesa redonda con una muestra representativa de grupos de la sociedad civil y continรบa manteniendo compromisos bilaterales para informar el compromiso y el programa de la Cumbre.

En las prรณximas semanas, el Gobierno seguirรก colaborando con la comunidad cientรญfica nacional e internacional, la sociedad civil y las empresas para escucharles sobre el contenido de la Cumbre y sobre cuestiones mรกs amplias relacionadas con la IA.

3.1 Ampliando la conversaciรณn

Para asegurar que la Cumbre pueda alcanzar los objetivos establecidos, es necesario garantizar un debate pequeรฑo y centrado durante el evento de dos dรญas, limitado a 100 participantes. Sin embargo, apreciamos la opiniรณn de muchas mรกs personas y organizaciones que tienen la experiencia y el deseo de contribuir a este tema crรญtico. El alcance de la Cumbre se centra en los riesgos de seguridad de la IA de vanguardia, pero nuestro compromiso mรกs amplio garantizarรก que tambiรฉn se discutan otras cuestiones importantes.

Para permitir que se escuche una gama mรกs amplia de voces, nos estamos asociando en cuatro eventos preliminares oficiales con la Royal Society, British Academy, techUK y The Alan Turing Institute. Los resultados de estos talleres se incorporarรกn directamente a la planificaciรณn de la Cumbre y publicaremos un resumen externo del compromiso.

| Fecha | Ponente | Objetivo |

|---|---|---|

| 11 octubre | The Alan Turing Institute | Analizar las fortalezas existentes del Reino Unido en materia de seguridad de la IA y las oportunidades de colaboraciรณn internacional. |

| 12 octubre | British Academy | Discutir las posibilidades de la IA para el bien pรบblico: la Cumbre y mรกs allรก. |

| 17 octubre | techUK | Analizar las oportunidades de la IA; Riesgos potenciales de la IA; Soluciones que existen en el sector tecnolรณgico. |

| 25 octubre | Royal Society | Explorar los riesgos de seguridad de la IA en todas las disciplinas cientรญficas. |

4. Compromiso pรบblico

La seguridad de la AI de frontera es un tema que nos afecta a todas las personas y no es simplemente una cuestiรณn de personas expertas en academia y tรฉcnica. En el mes previo a la Cumbre, pรบblico de cualquier parte del mundo podrรก hacer preguntas y compartir sus puntos de vista directamente con el gobierno britรกnico.

Los detalles del evento se compartirรกn con anticipaciรณn en los canales de redes sociales del Departamento de Ciencia, Innovaciรณn y Tecnologรญa (DSIT), con la posibilidad de verlo y publicar preguntas y comentarios en los canales de redes sociales en otros momentos.

| Fecha | Evento |

|---|---|

| 2 octubre | X Q&A con Matt Clifford, representante del Primer Ministro para la Cumbre de Seguridad de la IA |

| 16 octubre |

Q&A en LinkedIn con la Secretaria de Estado Michelle Donelan |

| 1 noviembre | Discursos de apertura en la transmisiรณn en vivo de la Cumbre |

Revisa el programa completo de la Cumbre de Seguridad de IA en esta pรกgina en inglรฉs.

A travรฉs de @scitechgovuk en X, LinkedIn, Facebook, Instagram y Threads se compartirรกn mรกs actualizaciones sobre la Cumbre y oportunidades para participar en el perรญodo previo a la Cumbre y durante toda ella:

*Las redes sociales mencionadas publican en inglรฉs.

5. Glosario

| ฐีรฉฐ๙ณพพฑฒิดว | ถูฑ๐ดฺพฑฒิพฑณฆพฑรณฒิ |

|---|---|

| IA, sistemas de IA o tecnologรญas de IA | Productos y servicios que son โadaptablesโ y โautรณnomosโ, en el sentido que se define en la secciรณn 3.2.1 del documento en inglรฉs AI White Paper. |

| Modelos Bรกsicosl | Los modelos bรกsicos son modelos entrenados con datos amplios a escala, de modo que puedan adaptarse a una amplia gama de tareas posteriores.ย - documento en inglรฉs . |

| IA de frontera | La IA de frontera estรก a la vanguardia del avance tecnolรณgico y, por lo tanto, ofrece la mayor cantidad de oportunidades, pero tambiรฉn presenta nuevos riesgos. Se refiere a modelos de IA de uso general altamente capaces, generalmente modelos bรกsicos, que pueden realizar una amplia variedad de tareas e igualar o superar las capacidades presentes en los modelos mรกs avanzados de la actualidad. Posteriormente, puede habilitar casos de uso limitados. |

| IA estrecha | La inteligencia artificial estrecha (IA estrecha) es una IA diseรฑada para realizar una tarea especรญfica. Es un tipo especรญfico de inteligencia artificial en el que un algoritmo de aprendizaje estรก diseรฑado para realizar una sola tarea o un conjunto reducido de tareas, y cualquier conocimiento adquirido al realizar la tarea no serรก automรกticamente aplicable ni transferible a una amplia variedad de tareas. |

| Automatizaciรณn masiva | La automatizaciรณn masiva es el proceso que lleva al software a completar tareas de una manera mรกs rรกpida, eficiente y econรณmica que la que pueden realizar los humanos. |